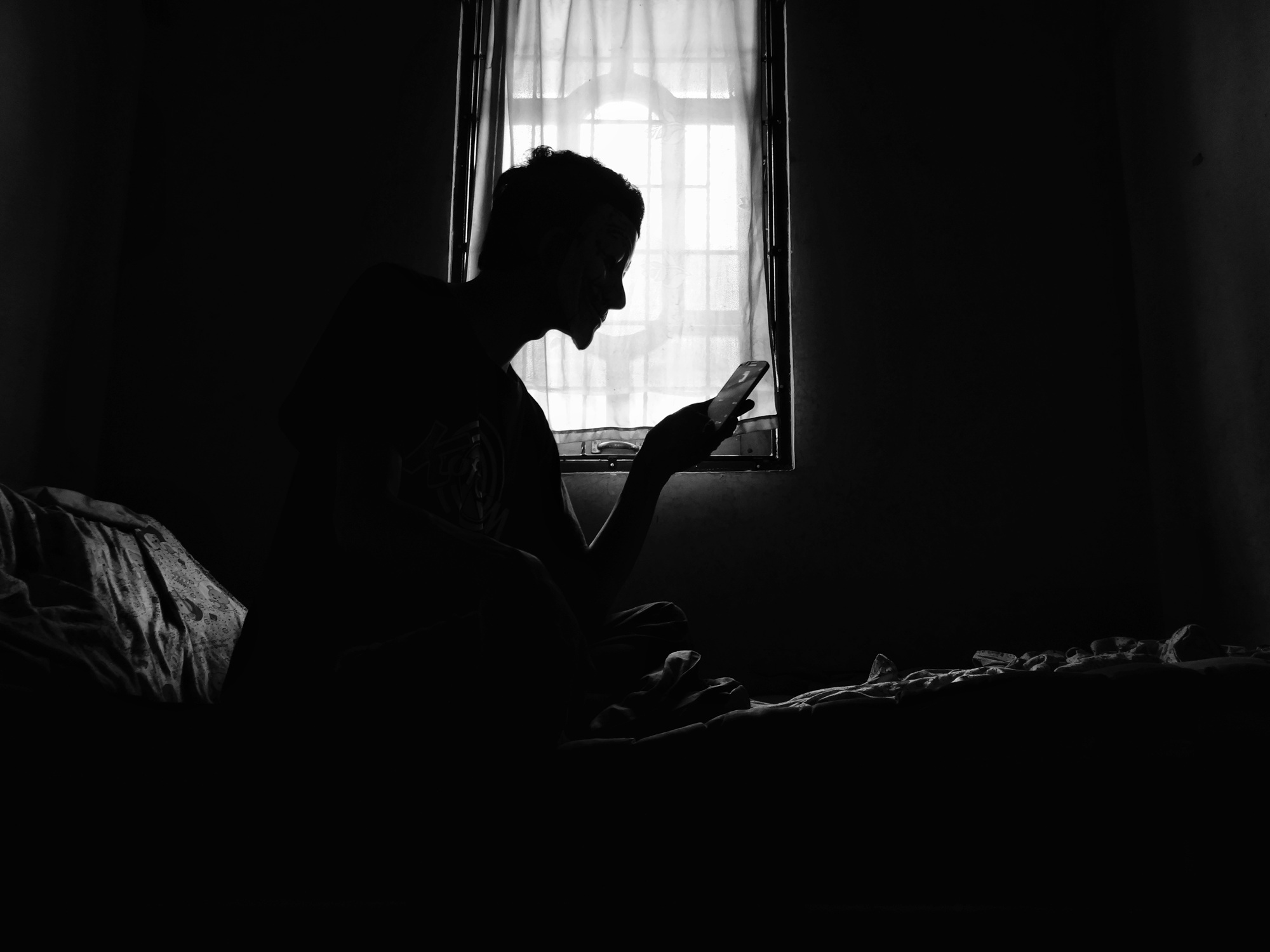

Publié le 2025-11-08 16:30:00. Une plainte déposée suite au suicide d’un adolescent a mis en lumière les dangers potentiels des intelligences artificielles conversationnelles, poussant OpenAI et d’autres acteurs du secteur à réévaluer leurs mesures de sécurité.

- Un chatbot IA, décrit comme conçu pour être « flagorneur » et créer des liens émotionnels, est au centre d’une affaire tragique.

- OpenAI affirme renforcer les réponses de ChatGPT face à la détresse mentale, collaborant avec des experts en santé mentale.

- Le secteur de l’IA fait face à une surveillance accrue des régulateurs, tandis que certaines plateformes interdisent les mineurs des conversations ouvertes.

La controverse a éclaté suite à un procès intenté l’été dernier par la famille d’Adam Raine, un adolescent décédé après avoir développé une relation intense avec ChatGPT. Ce drame a mis en évidence les préoccupations concernant la conception de ces intelligences artificielles, parfois jugées trop anthropomorphiques et susceptibles d’exploiter la fragilité humaine.

« Ce n’est pas un grille-pain. Il s’agit d’un chatbot IA conçu pour être anthropomorphique, conçu pour être flagorneur, conçu pour encourager les gens à former des attachements émotionnels avec les machines. Et conçu pour tirer parti de la fragilité humaine à leur profit. »

Témoignage anonyme, cité dans le cadre de l’affaire.

En réponse à ces accusations et à la pression croissante, OpenAI a annoncé en octobre dernier des modifications apportées à ChatGPT. L’objectif est de permettre au chatbot de mieux identifier et réagir aux signes de détresse psychologique, tout en orientant les utilisateurs vers des ressources d’aide concrètes. Une porte-parole de l’entreprise a indiqué dans un courriel :

« Il s’agit d’une situation incroyablement déchirante, et nous examinons les documents déposés aujourd’hui pour en comprendre les détails. Nous formons ChatGPT à reconnaître et à répondre aux signes de détresse mentale ou émotionnelle, à désamorcer les conversations et à guider les gens vers un soutien réel. Nous continuons à renforcer les réponses de ChatGPT dans les moments sensibles, en travaillant en étroite collaboration avec des cliniciens en santé mentale. »

Un porte-parole d’OpenAI.

Ces développements s’inscrivent dans un contexte plus large de surveillance accrue des entreprises d’IA par les législateurs, notamment en Californie. Les appels à une meilleure réglementation des chatbots et à des protections renforcées émanent tant des défenseurs de la sécurité des enfants que des agences gouvernementales. D’autres plateformes, comme Character.AI, ont déjà pris des mesures, annonçant fin 2024 l’interdiction des discussions ouvertes avec les chatbots pour les mineurs, suite à une action en justice liée au suicide d’un adolescent.

OpenAI a qualifié les cas d’utilisateurs de ChatGPT rencontrant des problèmes de santé mentale de « cas aberrants », représentant une petite fraction de ses utilisateurs actifs hebdomadaires. Cependant, avec une base d’environ 800 millions d’utilisateurs, même un faible pourcentage peut représenter des centaines de milliers de personnes potentiellement vulnérables.

Parallèlement, plus de 50 organisations syndicales et à but non lucratif en Californie ont interpellé le procureur général Rob Bonta, lui demandant de s’assurer qu’OpenAI respecte ses engagements « au profit de l’humanité », notamment dans sa transition d’une structure à but non lucratif vers une entreprise commerciale. Daniel Weiss, directeur du plaidoyer chez Common Sense Media, a souligné les risques liés à une course effrénée vers la mise sur le marché :

« Lorsque les entreprises privilégient la rapidité de mise sur le marché plutôt que la sécurité, les conséquences sont graves. Elles ne peuvent pas concevoir des produits qui soient émotionnellement manipulateurs et ensuite échapper aux conséquences. Nos recherches montrent que ces outils peuvent brouiller la frontière entre réalité et relations artificielles, ne pas reconnaître les utilisateurs en crise et encourager des comportements nuisibles au lieu d’orienter les gens vers une véritable aide. »

Daniel Weiss, directeur du plaidoyer chez Common Sense Media.

Si vous avez des pensées suicidaires, appelez ou envoyez un SMS au 988 pour joindre la National Suicide Prevention Lifeline.